隨著多種開源模型陸續問世,大型語言發展進程可謂百花齊放,台灣領先全球首創多產業共同開發 Project TAME,涵蓋電子製造、石化、醫療及法律等領域知識,展現出超越國際大型模型如GPT-4o、Gemini等的表現。

文/鄭宜芬·刊期/2024.08

「ChatGPT 不等於一切問題的答案」生成式AI存在幻覺、偏見、知識斷點等限制,以及核心技術與中國語言模型等隱憂。有鑒於此,台灣產學合作開發「繁體中文專家模型開源專案 TAiwan Mixture of Experts(簡稱 Project TAME)」問世,採用開源形式讓各產業企業透過 Hub 中心進行合作,結合各領域專家的資料,在不同資料間有共同交集可以使用,有益於台灣發展自己的語言模型,不再受限使用技術與文化框架。

LLMs存在三大限制

國立台灣大學資訊管理學系專任教授暨台灣人工智慧學校執行長林永松表示,人工智慧有強弱之分,強人工智慧(Strong AI)可以跟人一樣有很廣泛的智慧,具備執行智慧行為的能力,但目前尚未能實現;弱人工智慧(Weak AI)或許能在一件小事上表現得不錯,卻不能解決其他對人類而言相對容易的問題。

生成式 AI 根據機率回答的答案可能不完全是事實,輸出內容可能帶有偏見、生成的圖像可能缺乏構圖完整性,這與模型當初訓練時的資料品質有關。近年與 AI 相關的洩密和假訊息等問題逐漸浮現,須留意ChatGPT 不等於一切問題的答案。

幻覺 Hallucination

「一本正經的胡說八道」林永松指出,幻覺包含邏輯錯誤與無中生有等狀況,若溫度參數值設定太高,就可能導致幻覺。目前雖尚無絕對有效解方,但 Reflections 以及 Cross-checks by other LLMs 是可改善之方法。

偏見 Discrimination/Prejudice

模型是根據訓練資料學習,若訓練資料中存在偏見,將導致模型學到這些偏見,生成不準確或誤導性的訊息。尤其某些主題缺乏足夠的訓練資料,此情況會特別明顯,導致生成式 AI 可能含有種族、性別偏見內容。建議可強化訓練用文本資料篩檢、RLHF、fine-tuning、input filtering and output filtering、monitoring、user feedback、continuous learning/adjustment 來應對。

知識斷點 knowledge breakpoint

例如 GPT-3.5 模型的知識目前只更新到 2022 年 1 月,若向模型詢問 2022 年以後的 NBA 總冠軍得主,無法得到正確資訊。同樣的問題問 GPT-4,因知識更新到 2023 年 4 月,則可得到正確答案。想解決問題,建議可結合搜尋引擎、 RAG 資料源或其他較即時的資料源。

運用 LLMs 兩大方向

為了突破限制,深度學習機制能夠讓 AI 透過觀察單詞或短句在段落中的使用方式,來理解語言的含義。深度學習與機器學習各具優勢,其中深度學習的特色在於可以自動進行資料特徵萃取,不像機器學習需要人為制定特徵。

開源大語言模型(open-source LLM)可分享模型參數、模型架構、訓練方法以及訓練程式碼,有些模型還可分享訓練資料,開發者可以在現有模型的基礎上進行擴展和改進,無需從頭開始訓練。

Token 達5,000億

若企業運算資源、訓練模型的資料不夠,Project TAME 結合多產業資料,以開源形式提供下載,是由長庚醫院、律果科技、長春集團、和碩聯合科技、欣興電子、台大資工系與台大資管系等單位攜手合作,在 NVIDIA 支持下訓練而成。

Project TAME 是基於 Llama 38 B、70 B 的版本,訓練框架為 NVIDIA NeMo Megatron,推論框架為 NVIDIA TensorRT-LLM,演算法及算力的支持則來自 NVIDIA Taipei-1 的 DGX H100。團隊黃金三角囊括數據、算力、算法,具體方向包括:選擇基礎模型、領域強化、開源。

優勢 1:在地化

Project TAME 使用多家企業所提供醫療、法律、電子業、石化業等各專業領域資料,進行 5,000 億個字符(Token)的預訓練,發展出在地化特色,能準確解釋「很盤」等繁中語境用法。

優勢 2:產業化

在國考、升高中大學的題目上,Project TAME 能拿到的分數遠高於 GPT-4o、Gemini 等其他語言模型,且適合不同產業應用,是目前首創具備產業專業知識的開源模型,有助各產業快速且使用較低成本導入生成式 AI 落地應用。

優勢 3:省成本和時間

若企業從零開始訓練 1B 參數模型,需要耗費 3.8 億新台幣與 576 小時,而且 1B 參數的應用也相當侷限,但若透過 Project TAME 的 70B 參數模型作為訓練基礎,僅需 1,600 萬成本、以企業資料訓練模型一次迭代僅需 3.5 小時。

[ 推薦閱讀:企業面臨的 4 大項大型語言模型威脅 ]

集結醫療、法律、高科技製造等專業知識

Project TAME 可應用於各產業,林口長庚紀念醫院醫療人工智能核心實驗室副主任林器宏表示,目前長庚自主研發的生成式 AI 是以長庚高速運算中心為算力基礎,已經完成 5 項生成式 AI 的落地應用,包含護理會診、行政規章、專科照會、語音處理等,目前還有 28 案提案。

長庚提供 Project TAME 的公開資料包括衛教資料、醫療文獻、常見 QA,後續還會以此為基礎,使用長庚內部資料進行微調(fine- tuning),整合 Project TAME 至醫院內部的生成式 AI 服務中。

院內實驗室硬體部分使用 NVIDIA DGX V100 與 H100 共 10 台設備進行生成式 AI 的訓練與推論;軟體上使用 NeMo、TensorRT、Triton 、NIM、RAG 技術與 AIIS 平台進行開發與推論部署。

以產房出生紀錄為例,護理師於新生兒出生後,需測量其反應等生理紀錄,並記錄於醫院系統中,但因護理師雙手皆處於忙碌狀態,需另一位護理師協助進行輸入。若透過語音辨識模型將護理師口述語音轉為逐字稿,再經由大語言模型從逐字稿中理解訊息並完成報告,此過程僅需一位護理師進行測量時同步口述,即可同步生成報告,不僅能減少人力消耗,且能更有效率地完成其工作。

[ 加入 CIO Taiwan 官方 LINE 與 Facebook ,與全球 CIO 同步獲取精華見解 ]

專注於法律新創的律果科技團隊從法律專家到資料科學家,收集大量的法律語料,並進行清理,透過 Project TAME 提升法律服務的效率和精準度。執行長陳啟桐表示,法律內容有強烈的在地化需求,藉由協助 Project TAME 加入台灣法律語料進行訓練,以民國 112 年律師考試第一試成績換算,Project TAME 贏過約 89% 的考生。

還有,長春集團建立企業五大機能「產銷人發財」的戰情分析室,應用 AI 預測分析獲利及產品競爭風險;和碩聯合科技發展 AI 製造應用,快速累積訓練模型經驗;欣興電子透過公司內部資料庫,把模型調校成內部專用的產業專家模型,提供更符合公司內部作法的準確建議,提升工作效率。

現在 Project TAME 已正式對外開源,企業可從 Github 免費下載使用,也進一步考慮支援東南亞與東北亞更多語系。另外,亞太智能機器(APMIC)也整合 Project TAME,提供聊天機器人測試頁供使用者測試。

TAME突顯主權AI的必要性

不過,台灣為何需要在地化的語言模型?台大資訊工程學系副教授陳縕儂指出,首先,台灣若把資料提供給國外進行合作,核心技術仍然掌握在別人手上;再者,許多企業採用中國的語言模型,傳遞單一的文化不符合台灣人的生活型態。

台大資工系博士班學生林彥廷也表示,目前大型語言模型多由美國資料做訓練,對於繁體中文這類小語種來說能力相當有限。Project TAME 針對繁體中文最佳化,能夠進一步加強在地文化,精準推薦台灣事物及細節。

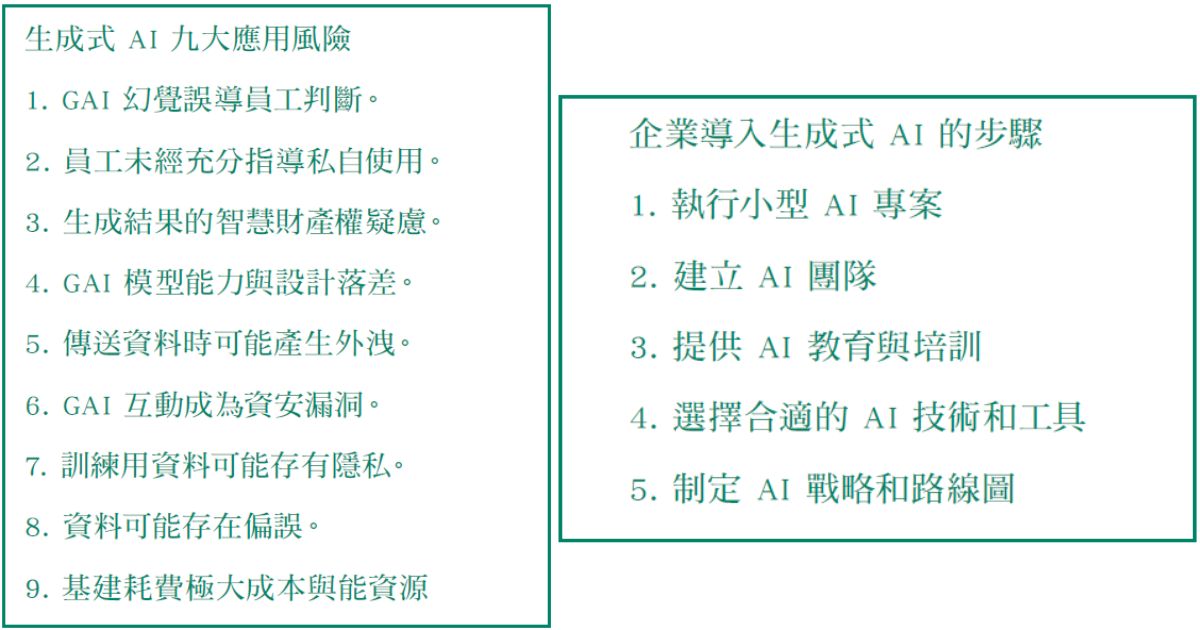

企業導入AI關鍵:由下而上

那麼公司或組織應如何開始使用 AI 呢?陳縕儂表示,若公司直接建立團隊宣布要做大型語言模型,員工未必知道如何應用。由於許多員工的工作是例行性事務,適合透過智慧化來改善,建議公司掌握「由下而上」的關鍵,由員工提出需求,公司再組成團隊使用工具予以協助,這樣的方式更加可行。

舉例來說,搜尋引擎剛問世的時候,各界都在摸索該如何使用,其實只要抱持開放與學習的心態,嘗試過後就會知道如何使用會有所幫助,而且現在資料齊全、介面易於使用,讓人更容易跟上 AI 時代。

[ 熱門精選:精鍊 AI 生成:5 種部署自家大型語言模型(LLM)的有效方式 ]

關鍵AI技術訓練自家模型

使用生成式 AI 應注意其應用瓶頸與風險,為解決痛點,林永松建議可利用 AI 關鍵技術,包括聯邦式學習、遷移學習、雲端運算、邊緣運算、整合學習、多模態模型、RAG(Retrieval-Augmented Generation)、GraphRAG 技術、AI Agents、Mixture-of-Agents、自動化製程參數及優化、Digital Twins、Markov Decision Process,讓企業可訓練自家合適的模型。

聯邦式學習

在聯邦式學習中,資料保持在本地設備上,不需要將其集中或傳輸到中心伺服器。模型訓練分布在多個設備(例如智慧型手機或個人電腦)上。由於資料不離開本地設備,聯邦式學習可以提高用戶的隱私保護。敏感數據如個人資料不需要共享給模型訓練者。同時,資料雖然留在本地,但訓練過程中學習到的模型更新(例如權重更新)會被發送回中央伺服器共享,可促進改進全局模型。

遷移學習

將一個任務上訓練好的預訓練模型應用於另一個相關任務,使用自己的資料,就可以對預訓練模型進行微調,達到因地制宜的效果。可以大幅提高機器學習的效率和準確性。

雲端運算

使用遠端伺服器網路來儲存、處理和管理資料,適合需要大量計算和儲存空間的應用,受到雲服務提供商的安全措施保護,安全性高,可以輕鬆增加更多的儲存和處理能力。

邊緣運算

通常是在本地機器或單板電腦上進行運算,適合需要快速反應和處理即時數據的應用,資料可以在本地處理,減少資料外洩風險,但擴展性受限於本地硬體和資源。

整合學習

透過結合多個學習算法來提高預測精度和模型的穩定性,基本類型包括 Bagging、Boosting 和 Stacking。

多模態模型

透過融合文本、圖片、語音、結構化數據與 3D 信號等多種數據來源,經過訓練生成一個基礎模型,並根據具體任務進行適應性調整,實現問答系統、情感分析、資訊提取、圖像描述、物體識別和指令跟隨等多樣化應用。使 AI 能夠提供更加全面的智慧解決方案。

RAG(Retrieval-Augmented Generation)技術

結合檢索和生成,透過用戶查詢檢索相關文檔片段,再將這些片段與查詢結合生成增強的上下文,利用大型語言模型生成更精確和豐富的回答,從而顯著提升回答的準確性和深度。

GraphRAG 技術

用於發現數據中的複雜關係。是結合基於圖的推理和檢索增強生成(RAG),提供更加豐富的上下文和精確的數據連接。廣泛適用於醫療保健、金融等多種領域,有效提升數據發現的效率和品質,為各行各業的數據分析和應用帶來新的突破。

AI Agents

是一種自主運行的軟體實體,具備感知、推理、學習和行動的能力,能根據環境資訊做出決策並執行任務。廣泛應用於虛擬助手、遊戲 AI、自動駕駛車輛和金融交易等領域,通過自動化使複雜任務變得更加高效與智慧,而且具備 LLMs、Planners、Memory and Tools。

林永松表示,Project TAME 未來計畫擴大應用領域,例如發展多模態、縮小化、強化 RLHF 技術、使用 SOTA foundation models 等,期盼藉此拋磚引玉,吸引更多企業參與,共同推動繁體中文專家模型的開發,創造台灣 AI 應用生態系,向世界證明 Taiwan Can Help。

(本文授權非營利轉載,請註明出處:CIO Taiwan)

LINE-台灣-技術長陳鴻嘉、LINE台灣董事長暨執行長陳立人、LINE台灣入口與內容事業群執行副總經理張景雯、LINE台灣企業解決方案事業群副總經理-吳方荃。-350x250.jpg)

LINE-台灣-技術長陳鴻嘉、LINE台灣董事長暨執行長陳立人、LINE台灣入口與內容事業群執行副總經理張景雯、LINE台灣企業解決方案事業群副總經理-吳方荃。-1140x570.jpg)